rishi sunak

-

La politica italiana sui temi dell’IA

Il 18 gennaio, Giorgia Meloni e Bill Gates hanno discusso dell’IA con Padre Benanti su rischi e opportunità.

-

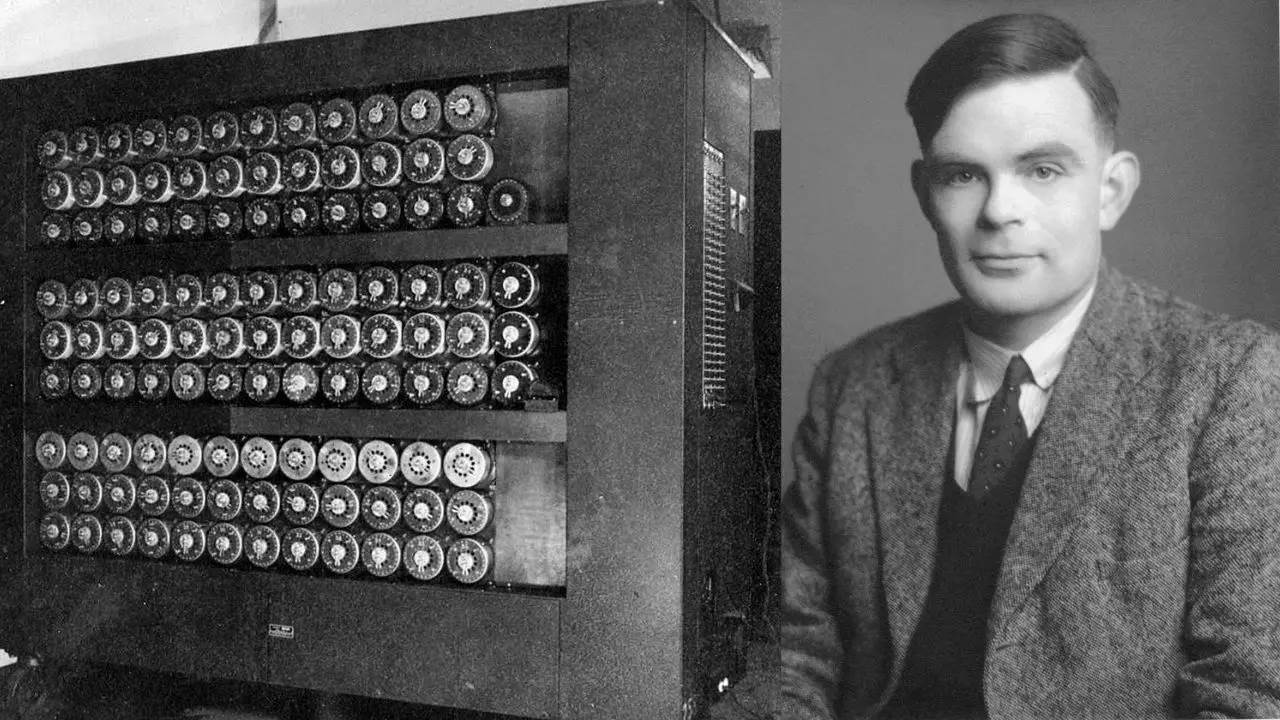

Safety Summit 2023

Al Vertice sulla Sicurezza dell’Intelligenza Artificiale 2023 a Bletchley Park, UK, 150 rappresentanti globali hanno discusso rischi e opportunità dell’IA, evidenziando…

-

AI Safety Summit

Il primo vertice Globale sulla Sicurezza dell’Intelligenza Artificiale, programmato per l’1 e il 2 novembre, ospitato dal Governo del Regno Unito…