Midjourney in campo contro i deepfake

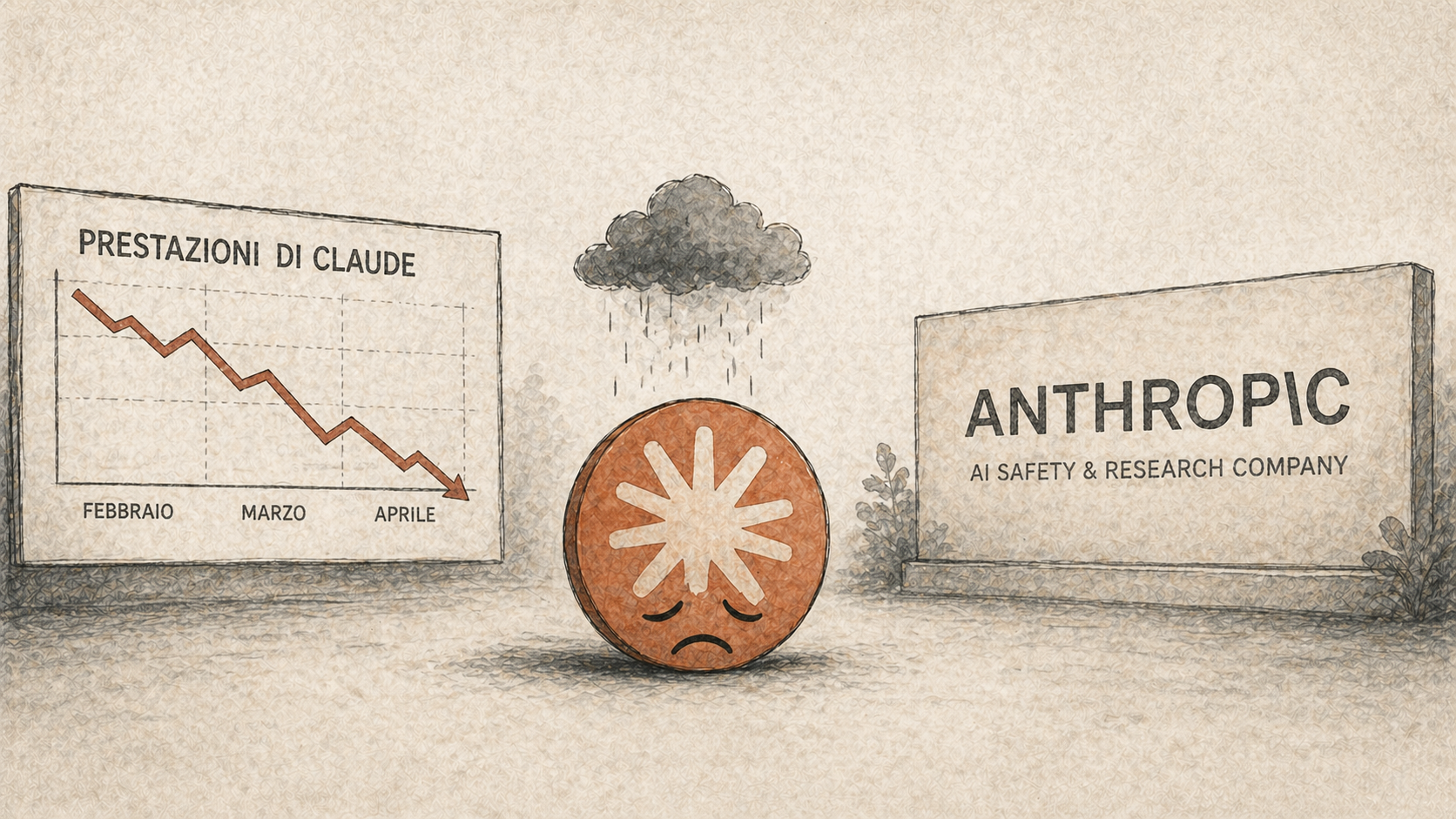

L’avvento dell’intelligenza artificiale sta catalizzando un profondo cambiamento nella nostra relazione con le informazioni, portando con sé, come abbiamo più volte riscontrato, una crescente minaccia per la democrazia: la diffusione della disinformazione.

immagine realizzata con IA

Tempo di lettura:

2 minuti

Alcune immagini,traduzioni e sintesi possono essere stati realizzati con ausilio di strumenti di intelligenza artificiale.

Storytelling e supervisione umani